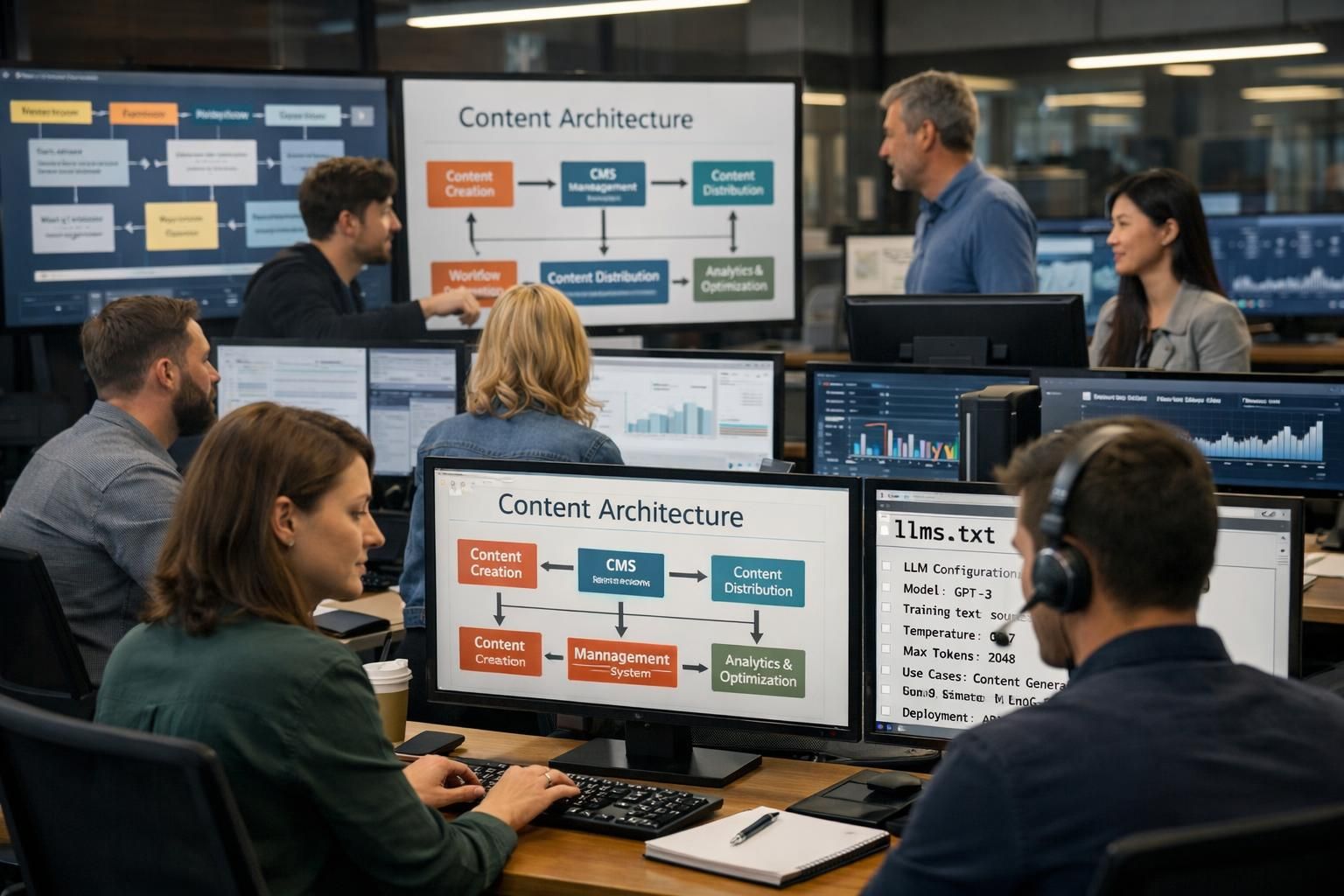

Wie baut man ein redaktionelles Cluster auf, das den KI-Filtern standhält? Verlage und Content-Teams suchen 2026 nach praktikablen Wegen, ihre Inhalte für klassische Suchmaschinen und die neuen KI-Filter gleichermaßen auffindbar zu machen. Fachliche Leitfäden und Tools wie der llms-txt-Generator rücken dabei in den Fokus: sie verbinden Content-Architektur, Themenrecherche und technische Vorgaben, damit Inhalte von Systemen wie ChatGPT, Bard oder Claude korrekt eingeordnet werden.

redaktionelles Cluster und Content-Strategie: Grundlagen für KI-Resilienz

Die Kernfrage für Redaktionen lautet, wie sich eine nachhaltige Content-Strategie entwickeln lässt, die sowohl die Leserbedürfnisse als auch die Anforderungen von KI-Systemen berücksichtigt. Ein erfolgreiches redaktionelles Cluster beginnt mit einer zentralen Pillar-Page, die ein Thema umfassend abbildet, und verzweigt in tiefergehende Cluster-Artikel.

Praxisorientierte Whitepaper und Branchenberichte empfehlen, bei der Themenrecherche die Nutzerintention strikt in den Mittelpunkt zu stellen und Inhalte nach Relevanz und Tiefe zu staffeln. Medienhäuser wie die Handelsblatt Media Group verfolgen in Tests einen kontrollierten Einsatz von KI, um die journalistische Qualität zu sichern und gleichzeitig Abläufe zu beschleunigen.

Handlungsfeld Redaktionelle Organisation und Content-Qualität

Wichtig ist, Redaktionsprozesse so zu organisieren, dass Content-Qualität und Verantwortlichkeiten klar bleiben. Dazu gehören Schulungen, eine Prompt-Datenbank und ein kleines KI-Team, das Tools evaluiert und Standards für Ethik und Faktenprüfung etabliert.

Dieses organisatorische Setting erhöht die Chance, dass Inhalte von KI-gestützten Abfragesystemen als vertrauenswürdig erkannt werden — ein zentraler Hebel gegen Fehlklassifikationen durch KI-Filter.

Themenrecherche, Semantische Analyse und Keyword-Optimierung für KI-Crawler

Die Art, wie Inhalte thematisch gegliedert sind, entscheidet inzwischen maßgeblich über Sichtbarkeit. Eine fundierte Semantische Analyse während der Themenrecherche zeigt, welche Unterthemen Nutzerfragen bedienen und welche Begriffe für Keyword-Optimierung relevant sind.

Pillar-Content und semantische Netzwerke statt starrer Kategorien

Eine Pillar-Page, etwa zu «Generative Engine Optimization», sollte Grundlagen, Definitionen und weiterführende Konzepte bieten. Verwandte Clusterseiten vertiefen technische Aspekte, Best Practices und Fallstudien. So entsteht ein semantisches Netzwerk, das KI-Crawlern erlaubt, Expertise und Zusammenhang zu erkennen.

In der Praxis empfiehlt sich, natürliche Fragen als Überschriften zu integrieren und strukturierte Daten zu verwenden. Diese Vorgehensweise erhöht die Wahrscheinlichkeit, bei komplexen KI-Anfragen berücksichtigt zu werden und reduziert die Abhängigkeit von reinem Keyword-Stuffing.

Interne Verlinkung, llms.txt und Messbarkeit gegen KI-Filter-Effekte

Interne Links sind für KI-Filter oft entscheidender als für klassische Suchmaschinenoptimierung. Semantisch präzise Ankertexte, bidirektionale Verlinkungen zwischen Pillar- und Cluster-Seiten sowie Breadcrumbs schaffen klare Pfade für maschinelles Verständnis.

Von Analyse bis Monitoring: Implementierung mit dem llms-txt-Generator

Der empfohlene Ablauf beginnt mit einer Website-Analyse, gefolgt vom Mapping thematischer Zusammenhänge und der Identifikation von Gaps. Auf dieser Basis kann eine optimierte llms.txt-Datei generiert und implementiert werden. Anschließend sind Monitoring-Metriken wichtig: Traffic aus KI-Quellen, Nutzerpfade innerhalb des Clusters und A/B-Tests verschiedener Verlinkungsmodelle.

Die Quintessenz: Redaktionen, die Content-Architektur, Semantische Analyse und technische Signale wie llms.txt kombinieren, reduzieren das Risiko, von KI-Filtern übersehen oder missgedeutet zu werden. Das ist eine strategische Investition in die langfristige Auffindbarkeit und Relevanz ihrer Inhalte.